Skillnaden mellan linjär regression vs logistisk regression

Följande artikel Linjär regression vs logistisk regression ger de viktigaste skillnaderna mellan båda, men innan vi ser vad betyder regression?

regression

Regression är i grunden ett statistiskt mått för att bestämma styrkan hos förhållandet mellan en beroende variabel, dvs. utgången Y och en serie andra oberoende variabler, dvs X 1, X 2 och så vidare. Regressionsanalys används i princip för förutsägelse och prognos.

Vad är linjär regression?

Linjär regression är en algoritm som bygger på den övervakade inlärningsdomänen för maskininlärning. Den ärver ett linjärt förhållande mellan dess inmatningsvariabler och den enskilda utgångsvariabeln där utgångsvariabeln är kontinuerlig. Det används för att förutsäga värdet på output låt oss säga Y från ingångarna låt oss säga X. När bara en enda ingång anses kallas det enkel linjär regression.

Det kan klassificeras i två huvudkategorier:

1. Enkel regression

Verksamhetsprincipen: Huvudmålet är att ta reda på ekvationen för en rak linje som bäst passar de samplade data. Denna ekvation beskriver algebraiskt förhållandet mellan de två variablerna. Den bäst passande raka linjen kallas regressionslinje.

Y = β 0 + β 1 X

Var,

p representerar funktionerna

P 0 representerar skärningen

P 1 representerar koefficienten för funktion X

2. Multivariabel regression

Det används för att förutsäga en korrelation mellan mer än en oberoende variabel och en beroende variabel. Regression med mer än två oberoende variabler bygger på att anpassa formen till konstellationen av data i en flerdimensionell graf. Regressionens form bör vara sådan att den minimerar formens avstånd från varje datapunkt.

En linjär relationsmodell kan representeras matematiskt enligt nedan:

Y = β 0 + β 1 X 1 + β 2 X 2 + β 3 X 3 + ……. + β n X n

Var,

p representerar funktionerna

P 0 representerar skärningen

P 1 representerar koefficienten för funktion X

p representerar koefficienten för funktion Xn

Fördelar och nackdelar med linjär regression

Nedan ges fördelar och nackdelar:

fördelar

- På grund av dess enkelhet används den i stor utsträckning modellering för förutsägelser och slutsatser.

- Det fokuserar på dataanalys och databehandling. Så det handlar om olika data utan att bry sig om detaljerna i modellen.

nackdelar

- Det fungerar effektivt när data normalt distribueras. För effektiv modellering måste således kollineariteten undvikas.

Vad är logistisk regression?

Det är en form av regression som tillåter förutsägelse av diskreta variabler med en blandning av kontinuerliga och diskreta prediktorer. Det resulterar i en unik transformation av beroende variabler som inte bara påverkar uppskattningsprocessen utan också koefficienterna för oberoende variabler. Den tar upp samma fråga som multipel regression gör men utan fördelande antaganden om prediktorerna. I logistisk regression är utfallsvariabeln binär. Syftet med analysen är att bedöma effekterna av flera förklarande variabler, som kan vara numeriska eller kategoriska eller båda.

Typer av logistisk regression

Nedan finns de två typerna av logistisk regression:

1. Binär logistisk regression

Den används när den beroende variabeln är dikotom, dvs. som ett träd med två grenar. Den används när den beroende variabeln är icke-parametrisk.

Används när

- Om det inte finns någon linearitet

- Det finns bara två nivåer för den beroende variabeln.

- Om multivariat normalitet är tveksamt.

2. Multinomial logistisk regression

Multinomial logistisk regressionsanalys kräver att de oberoende variablerna är metriska eller dikotoma. Det gör inga antaganden om linearitet, normalitet och homogenitet av varians för de oberoende variablerna.

Den används när den beroende variabeln har mer än två kategorier. Det används för att analysera förhållanden mellan en icke-metrisk beroende variabel och metriska eller dikotona oberoende variabler och jämför sedan flera grupper genom en kombination av binära logistiska regressioner. I slutändan ger det en uppsättning koefficienter för var och en av de två jämförelserna. Koefficienterna för referensgruppen anses vara alla nollor. Slutligen görs förutsägelse baserat på den högsta resulterande sannolikheten.

Fördel med logistisk regression: Det är en mycket effektiv och allmänt använd teknik eftersom den inte kräver många beräkningsresurser och inte kräver någon inställning.

Nackdelen med logistisk regression: Den kan inte användas för att lösa icke-linjära problem.

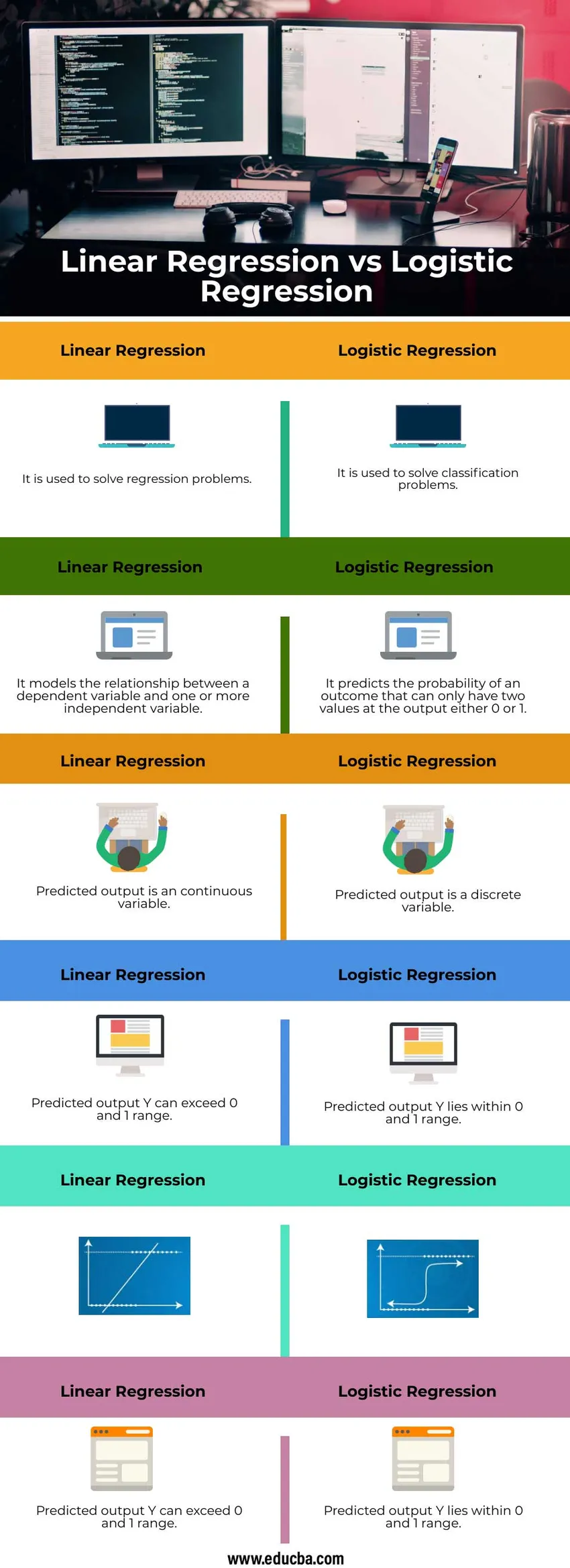

Head to Head jämförelse mellan Linear Regression vs Logistic Regression (Infographics)

Nedan visas de 6 främsta skillnaderna mellan Linear Regression vs Logistic Regression

Nyckelskillnaden mellan den linjära regressionen vs logistisk regression

Låt oss diskutera några av de viktigaste skillnaderna mellan linjär regression vs logistisk regression

Linjär regression

- Det är en linjär strategi

- Den använder en rak linje

- Det kan inte ta kategoriska variabler

- Det måste ignorera observationer med saknade värden för den numeriska oberoende variabeln

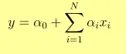

- Utgång Y anges som

- 1 enhetsökning i x ökar Y med α

tillämpningar

- Förutsäga priset på en produkt

- Förutsäga poäng i en match

Logistisk återgång

- Det är en statistisk strategi

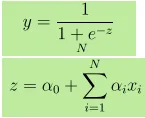

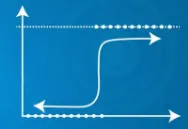

- Den använder en sigmoid-funktion

- Det kan ta kategoriska variabler

- Det kan fatta beslut även om observationer med saknade värden finns

- Utgång Y anges som, där z anges som

- 1 enhetsökning i x ökar Y med log odds av α

- Om P är sannolikheten för en händelse är (1-P) sannolikheten för att den inte inträffar. Odds för framgång = P / 1-P

tillämpningar

- Förutsäger om det idag kommer att regna eller inte.

- Förutsäga om ett e-postmeddelande är skräppost eller inte.

Linjär regression jämfört med logistisk regression jämförelsetabell

Låt oss diskutera den bästa jämförelsen mellan Linjär regression vs logistisk regression

|

Linjär regression |

Logistisk återgång |

| Det används för att lösa regressionsproblem | Det används för att lösa klassificeringsproblem |

| Den modellerar förhållandet mellan en beroende variabel och en eller flera oberoende variabler | Den förutsäger sannolikheten för ett utfall som bara kan ha två värden vid utgången antingen 0 eller 1 |

| Den förutsagda utgången är en kontinuerlig variabel | Den förutsagda utgången är en diskret variabel |

| Förutsedd utgång Y kan överstiga 0 och 1 intervall | Förutsedd utgång Y ligger inom 0 och 1 intervall |

|  |

| Förutsedd utgång Y kan överstiga 0 och 1 intervall | Förutsagd utgång |

Slutsats

Om funktioner inte bidrar till förutsägelse eller om de är mycket korrelerade med varandra lägger det till ljud till modellen. Så funktioner som inte bidrar tillräckligt med modellen måste tas bort. Om oberoende variabler är mycket korrelerade kan det orsaka ett problem med multikollinearitet, som kan lösas genom att köra separata modeller med varje oberoende variabel.

Rekommenderade artiklar

Detta har varit en guide till Linear Regression vs Logistic Regression. Här diskuterar vi Linjär regression vs logistisk regression viktiga skillnader med infografik och jämförelsetabell. Du kan också titta på följande artiklar för att lära dig mer–

- Data Science vs Data Visualization

- Machine Learning vs Neural Network

- Övervakad inlärning kontra djup inlärning

- Logistisk regression i R