Introduktion till typer av maskininlärningsalgoritmer

Maskininlärningsalgoritmtyper eller AI-beräkningar är program (matematik och skäl) som modifierar sig för att prestera bättre när de presenteras för mer information. Att "anpassa" en del av AI innebär att dessa projekt ändrar hur de bearbetar information efter en tid, precis som människor ändrar hur de bearbetar information genom att lära sig. Så en maskininlärning eller AI-beräkning är ett program med en speciell metod för att ändra sina helt egna parametrar, med tanke på kritik på sina tidigare utställningsförväntningar om ett datasæt.

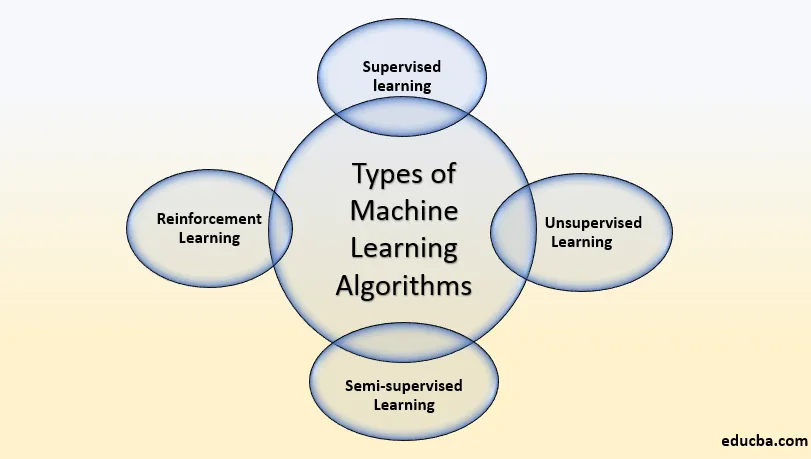

Alla typer av maskininlärningsalgoritmer

Deras vissa varianter av hur man karakteriserar typerna av maskininlärningsalgoritmtyper, men vanligtvis kan de delas in i klasser enligt deras motivation och de grundläggande klassificeringarna är de medföljande:

- Övervakad inlärning

- Oövervakat lärande

- Semi-handledd lärande

- Förstärkningslärande

Vad är Supervised Learning

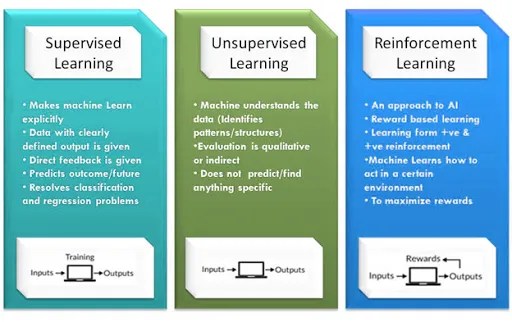

Handledat lärande är där du kan överväga att lärandet styrs av en instruktör. Vi har ett datasæt som fungerar som en lärare och dess uppgift är att förbereda modellen eller maskinen. När modellen blir förberedd kan den börja lösa sig på en förväntning eller ett val när ny information ges till den.

Exempel på Supervised Learning:

- Du får en hel del fotografier med data om vad som finns på dem och efter det tränar du en modell för att uppfatta nya fotografier.

- Du har mycket data om huspriser baserat på deras storlek och plats och du matar in den i modellen och utbildar den så kan du förutsäga priset för andra hus baserat på data du matar.

- Om du vill förutsäga att ditt meddelande är skräppost eller inte baserat äldre meddelande du har kan du förutsäga att ett nytt meddelande är skräppost eller inte.

Den övervakade inlärningsalgoritmen är som följer:

1) Linjär regression

linjär regression är värdefull för att upptäcka sambandet mellan två ihållande faktorer. Den ena är en prediktor eller autonom variabel och den andra är en reaktions- eller avdelningsvariabel. Den söker efter mätbara förhållanden, dock inte en deterministisk relation. Förbindelsen mellan två faktorer sägs vara deterministisk vad gäller chansen att en variabel exakt kan kommuniceras av den andra. Till exempel, med användning av temperatur i grad Celsius, är det tänkbart att exakt förutse Fahrenheit. Det faktiska förhållandet är inte exakt när man bestämmer en koppling mellan två faktorer. Till exempel, anslutning någonstans inom intervallet mellan höjd och vikt. Centraltanken är att få en linje som bäst passar informationen. Den bästa passformen är den för vilken all-out prognosblunder (all informationsfokus) är så lite som kan förväntas under omständigheterna. Felet är skillnaden mellan punkten till regressionslinjen.

2) Beslutsträd

Ett beslutsträd är en beslutshjälp-gadget som använder ett trädliknande diagram eller modell av beslut och deras potentiella resultat, inklusive resultat av slumpmässiga händelser, resurskostnader och verktyg. Utforska bilden för att få en känsla av vad den liknar.

3) Naive Bayes klassificering

Naive Bayes klassificerar en grupp grundläggande probabilistiska klassificerare som är beroende av att tillämpa Bayes teori med starkt (osofistikerat) självstyre med egenskaperna Naive Bayes. Denna klassificering Några av de certifierbara modellerna är:

Att stämpla ett e-postmeddelande som skräppost eller inte som skräppost

Beställ en nyhet om innovation, statliga frågor eller sport

Kontrollera en touch av ämne som ger positiva känslor eller negativa känslor?

Används för programmering av ansiktsbekräftelse.

4) Logistisk regression

Logistisk regression är en banbrytande faktummetod för att visa ett binomialt resultat med minst en informativa faktorer. Den kvantifierar kopplingen mellan den absoluta avdelningsvariabeln och minst en fri faktor genom att utvärdera sannolikheter med en logistisk kapacitet, vilket är det kombinerade logistiska anslaget.

Normalt kan regressioner användas i verkligheten som:

Kreditvärdighet

Mätet på framgångshastigheten för marknad eller företag

För att förutsäga intäkterna från ett företag eller någon produkt

Finns det någon jordbävning någon dag?

5) Vanlig minsta kvadratregression

Minst kvadrater är en strategi för att utföra direkt regression. direkt regression är åtagandet att anpassa en linje genom många fokus. Det finns olika möjliga förfaranden för att göra detta, och "vanliga minsta rutor" går så här - Du kan rita en linje, och efter det för alla datacentra, mäta den vertikala frigöringen mellan punkten och linjen och integrera dessa upp; den monterade linjen skulle vara den plats där detta aggregat av skiljeväggar är så magra som kan vara normalt mot bakgrund av den nuvarande situationen.

Vad är oövervakat lärande?

Modellen lär sig genom uppfattning och upptäcker strukturer i informationen. När modellen ges en dataset, upptäcker den följaktligen exempel och anslutningar i datasatsen genom att skapa klasser i den. Vad det inte kan göra är att lägga till märken i gäng, liknande det kan inte säga att detta är en samling av äpplen eller mango, men det kommer att isolera alla äpplen från mango.

Anta att vi visade bilder av äpplen, bananer och mango till modellen, så vad den gör, med tanke på vissa exempel och anslutningar gör det att grupper och partitioner datasättet i dessa grupper. För närvarande om en annan information förstärks till modellen lägger den till en av de gjorda bunterna.

Exempel på oövervakat lärande

- Du har många fotografier av 6 individer ännu utan data om vem som är på vilken och du måste isolera detta datasätt i 6 högar, var och en med fotografierna från en person.

- Du har partiklar, en del av dem är mediciner och en del är dock inte du inser vilket kommer att vara vilket och du behöver beräkningen för att hitta medicinerna.

Den oövervakade inlärningsalgoritmen är som följer

Clustering

Klustering är en viktig idé när det gäller undervisning. Det lyckas för det mesta hitta en struktur eller exempel i en insamling av okategoriserad information. Clustering-beräkningar kommer att behandla din information och upptäcka karakteristiska kluster (grupper) i händelse av att de finns i informationen. Du kan på samma sätt ändra vilket antal klossar dina beräkningar borde skilja. Det gör att du kan ändra granuliteten hos dessa sammankomster.

Det finns olika typer av kluster som du kan använda

- Selektiv (fördelning)

- Modell: K-betyder

- agglomerativ

- Modell: Hierarkisk gruppering

- Beläggning

- Modell: Fuzzy C-Means

- sannolikhets

Klusteralgoritmtyper

- Hierarkisk gruppering

- K-betyder klustering

- K-NN (k närmaste grannar)

- Huvudkomponentanalys

- Solitary Value Decomposition

- Oberoende komponentanalys

- Hierarkisk klustering

Hierarkisk klustering

Hierarkisk klustering är en beräkning som konstruerar en hackningsordning för grupper. Det börjar med alla de uppgifter som släpps ut till sitt eget gäng. Här kommer två nära grupper i en liknande grupp. Denna beräkning stängs när det bara finns en grupp kvar.

K-betyder Clustering

K betyder att det är en iterativ klusterberäkning som uppmuntrar dig att hitta det mest anmärkningsvärda incitamentet för varje betoning. Till att börja med väljs det ideala antalet grupper. I denna klusteringsteknik måste du samla in den information som fokuserar på k-samlingar. En större k betyder litenare sammankomster med större granularitet på liknande sätt. En lägre k betyder större sammankomster med mindre granularitet.

Utbytet av beräkningen är en samling av "namn." Det tillåter information som pekar på en av k-samlingarna. I k-betyder klustering kännetecknas varje samling av att skapa en centroid för varje samling. Centroids är som kärnan i gäng, som fångar fokus närmast dem och lägger dem till gruppen.

K-medelklustering kännetecknar ytterligare två undergrupper

- Agglomerativ gruppering

- dendrogram

Agglomerativ gruppering

Den här typen av K-betyder kluster börjar med ett fast antal klasser. Den anger all information till ett exakt antal grupper. Denna klusterstrategi kräver inte antalet grupper K som info. Agglomerationsförfarandet börjar med att forma varje datum som en ensam gäng.

Denna strategi utnyttjar en viss separationsåtgärd, minskar antalet buntar (en i varje betoning) genom att kombinera process. Sammanfattningsvis har vi en stor grupp som innehåller alla artiklarna.

dendrogram

I Dendrogram-klusteringstekniken talar varje nivå till en tänkbar gäng. Dendrogrammets längd visar graden av likhet mellan två sammanfogade grupper. Ju närmare basen för förfarandet är de gradvis jämförbara gäng som är att hitta samlingen från dendrogram som inte är karakteristisk och för det mesta abstrakt.

K-närmaste grannar

K-närmaste granne är den mest enkla av alla AI-klassificerare. Det varierar från andra AI-procedurer, eftersom det inte levererar en modell. Det är en enkel beräkning som lagrar varje enskilt tillgängligt fall och karakteriserar nya exempel beroende på en mått.

Det fungerar mycket bra när det finns en åtskillnad mellan modeller. Inlärningshastigheten är måttlig när förberedelset är enormt, och separationsfigureringen är icke-trivial.

Analys av huvudkomponenter

På chansen att du behöver ett högdimensionellt utrymme. Du måste välja en anledning till det utrymmet och bara de 200 mest betydelsefulla poäng för det förutsättningen. Denna bas är känd som en huvudkomponent. Den delmängd du väljer utgör ett annat utrymme som har liten storlek i kontrast till unikt utrymme. Det håller dock upp mycket av den mångfacetterade informationen som man kunde förvänta sig.

Vad är förstärkningslärande?

Det är kapaciteten hos en specialist att samarbeta med jorden och upptäcka vad som är det bästa resultatet. Det bedriver idén om hit och preliminär teknik. Operatören belönas eller straffas med en poäng för ett rätt eller off-bas svar, och baserat på den positiva belöningen fokuserar plockade upp själva modelltågen. Även en gång förberedd det förbereder sig för att förutse den nya information som introducerats till den.

Exempel på förstärkningslärande

- Visning av annonser, enligt användarnas ogillar, optimerar under lång tid

- Känn annonsbudget som används i realtid

- omvänd förstärkning att lära känna kunder som gillar inte bättre

Vad är Semi-Supervised Learning?

Semi-övervakad typ av lärande, beräkningen är beredd på en blandning av namngivna och omärkta information. Normalt kommer denna blandning att innehålla en begränsad mängd namngivna information och mycket omärkt information. Den grundläggande metoden som ingår är att för det första kommer programvaruingenjören att gruppera jämförbar information med hjälp av en obelastad inlärningsberäkning och därefter använda den aktuella namngivna informationen för att namnge resten av den ommärkta informationen. De vanliga användningsinstanserna av en sådan beräkning har en typisk egenskap bland dem. Att få omärkt information är i allmänhet blygsam medan namnet på nämnda information är över dyrt. Naturligtvis kan man föreställa sig de tre typerna av inlärningsberäkningar som Supervised att inse där en understudy är under överinseende av en instruktör både hemma och i skolan. Oövervakad inse var en underudiker måste förstå en idé själv och semi-Supervised att inse var läraren visar ett par idéer i klassen och ger förfrågningar som skolarbete som är beroende av jämförbara idéer.

Exempel på Semi-Supervised Learning

Det är enastående att mer information = modeller av bättre kvalitet i djupgående inlärning (upp till en specifik inneslutningspunkt tydligt, men oftare har vi inte så mycket information.) Vara det att det är dyrt att få märkt information. I händelse av att du behöver förbereda en modell för att särskilja bevingade djur kan du ställa in en hel del kameror för att därmed ta bilder av fåglar. Det är i allmänhet blygsamt. Att kontrahera individer för att markera dessa foton är kostsamt. Överväg möjligheten att du har ett enormt antal bilder av vingade djur, men bara kontrahera individer för att markera en liten delmängd av fotona. Som det visade sig, istället för att bara träna modellerna i den markerade underuppsättningen, kan du förutbilda modellen på hela träningsuppsättningen innan du finjusterar den med den nämnda delmängden, och du visar tecken på förbättringsutförande i dessa linjer. Det är halvledd lärande. Det avsätter dina kontanter.

Slutsats

Det finns många typer av maskininlärningsalgoritmer som finns där och baserat på olika olika förhållanden måste vi använda den bästa passningsalgoritmen för bästa resultat. Det finns många algoritmer som hittar den bästa noggrannheten för varje maskininlärningsalgoritmtyper och som är den högsta noggranna vi måste använda den algoritmen. Vi kan minimera felet i varje algoritm genom att minska brus i data. Till sist kommer jag att säga att det inte finns en enda maskininlärningsalgoritm som kan ge dig 100 procent noggrannhet, även den mänskliga hjärnan kan inte göra det så hitta den bästa granalgoritmen för dina data.

Rekommenderade artiklar

Detta är en guide till typer av maskininlärningsalgoritmer. Här diskuterar vi vad som är maskininlärningsalgoritm ?, och dess typer inkluderar övervakat lärande, oövervakat lärande, halvövervakat lärande, förstärkningslärande. Du kan också titta på följande artiklar för att lära dig mer -

- Maskininlärningsmetoder

- Maskininlärningsbibliotek

- Maskininlärningsmodeller

- Maskininlärningsramar

- Hyperparameter-maskininlärning

- Hierarkisk klustering Agglomerativ & delande kluster

- Skapa beslutsträd | Hur man skapar | fördelar

- Maskinlärande livscykel | Topp 8 etapper