Introduktioner till datavetenskapliga algoritmer

En beskrivning på hög nivå av de väsentliga algoritmerna som används i Data Science. Som ni redan vet är datavetenskap ett studieområde där beslut fattas baserat på den insikt vi får från data istället för klassiska regelbaserade deterministiska tillvägagångssätt. Vanligtvis kan vi dela upp en maskininlärningsuppgift i tre delar

- Få informationen och kartlägga affärsproblemet,

- Tillämpa maskininlärningstekniker och observera prestandametriket

- Testa och distribuera modellen

Under hela denna livscykel använder vi olika datavetenskapliga algoritmer för att lösa uppgiften. I den här artikeln kommer vi att dela upp de mest använda algoritmerna baserat på deras inlärningstyper och kommer att ha en diskussion på hög nivå om dem.

Typer av datavetenskapliga algoritmer

Baserat på inlärningsmetoderna kan vi helt enkelt dela maskininlärning eller datavetenskapliga algoritmer i följande typer

- Övervakade algoritmer

- Oövervakade algoritmer

1. Övervakade algoritmer

Som namnet antyder övervakade algoritmer är en klass av maskininlärningsalgoritmer där modellen tränas med märkta data. Baserat på historiska data vill du till exempel förutsäga att en kund kommer att ha ett lån eller inte. Efter förbehandling och funktionshantering av märkta data tränas övervakade algoritmer över strukturerade data och testas över en ny datapunkt eller i detta fall för att förutsäga ett låneförluster. Låt oss dyka in i de mest populära maskininlärningsalgoritmerna.

- K Närmaste grannar

K närmaste grannar (KNN) är en av de enklaste men ändå kraftfulla maskininlärningsalgoritmerna. Det är en övervakad algoritm där klassificeringen görs baserat på k närmaste datapunkter. Tanken bakom KNN är att liknande punkter grupperas ihop, genom att mäta egenskaperna för närmaste datapunkter kan vi klassificera en testdatapunkt. Vi löser till exempel ett standardklassificeringsproblem där vi vill förutsäga en datapunkt tillhör klass A eller klass B. Låt k = 3, nu testar vi 3 närmaste datapunkt för testdatapunkten, om två av dem tillhör klass A kommer vi att förklara testdatapunkten som klass A annars klass B. Rätt värde på K hittas genom korsvalidering. Den har en linjär tidskomplexitet och kan därför inte användas för applikationer med låg latens.

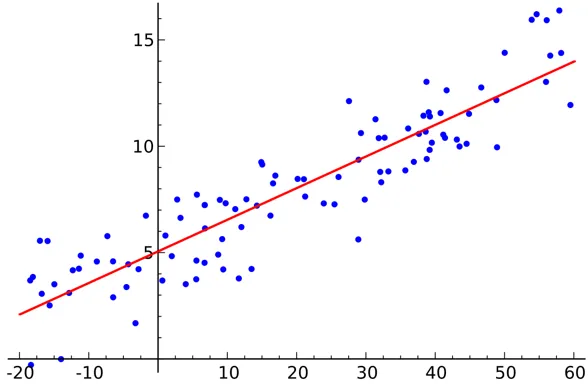

- Linjär regression

Linjär regression är en övervakad datavetenskaplig algoritm.

Produktion:

Variabeln är kontinuerlig. Tanken är att hitta ett hyperplan där det maximala antalet poäng ligger i hyperplanet. Till exempel är att förutsäga mängden regn ett vanligt regressionsproblem där linjär regression kan användas. Linjär regression antar att förhållandet mellan de oberoende och beroende variablerna är linjära och att det finns mycket liten eller ingen multikollinearitet.

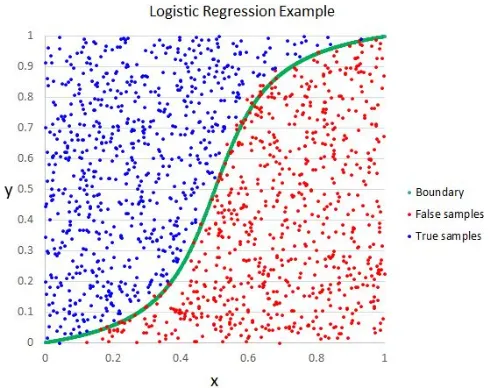

- Logistisk återgång

Även om namnet säger regression är logistisk regression en övervakad klassificeringsalgoritm.

Produktion:

Den geometriska intuitionen är att vi kan skilja olika klassetiketter med en linjär beslutsgräns. Utgångsvariabeln för logistisk regression är kategorisk. Observera att vi inte kan använda medelkvadratfel som en kostnadsfunktion för logistisk regression eftersom det är icke-konvex för logistisk regression.

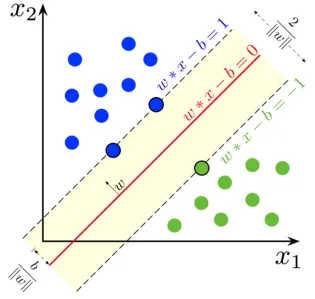

- Support Vector Machine

I logistisk regression var vårt huvudmotto att hitta en separerande linjär yta.

Produktion:

Vi kan betrakta Support-vektormaskinen som en förlängning av denna idé där vi måste hitta ett hyperplan som maximerar marginalen. Men vad är en marginal? För en vektor W (beslutsytan vi behöver komma på) drar vi två parallella linjer på båda sidor. Avståndet mellan dessa två rader kallas marginalen. SVM antar att uppgifterna är linjärt separerbara. Även om vi kan använda SVM för icke-linjär data också med hjälp av Kernel-tricket.

- Beslutsträd

Beslutsträd är en kapslad If-Else-baserad klassificerare som använder en trädliknande grafstruktur för att fatta beslutet. Beslutsträd är mycket populära och en av de mest använda övervakade maskininlärningsalgoritmerna inom hela datavetenskapen. Det ger bättre stabilitet och noggrannhet i de flesta fall jämförelsevis än andra övervakade algoritmer och robust mot outliers. Outputvariabeln från beslutsträdet är vanligtvis kategorisk men den kan också användas för att lösa regressionsproblem.

- ensembler

Ensembler är en populär kategori av datavetenskapliga algoritmer där flera modeller används tillsammans för att få bättre prestanda. Om du är bekant med Kaggle (en plattform från Google för att öva och tävla i datavetenskapliga utmaningar) kommer du att hitta de flesta vinnarlösningar som använder någon form av ensembler.

Vi kan grovt dela upp ensemblar i följande kategorier

- Säckväv

- öka

- Stacking

- Cascading

Random Forest, Gradient Boosting Decision Trees är exempel på några populära ensemble-algoritmer.

2. Oövervakade algoritmer

Oövervakade algoritmer används för de uppgifter där data inte är märkta. Det mest populära fallet med oövervakade algoritmer är kluster. Clustering är uppgiften att gruppera liknande datapunkter utan manuell intervention. Låt oss diskutera några av de populära oövervakade maskininlärningsalgoritmerna här

- K betyder

K Means är en slumpmässig oövervakad algoritm som används för klustering. K Means följer stegen nedan

1. Initiera K-punkter slumpmässigt (c1, c2..ck)

2. För varje punkt (Xi) i datauppsättningen

Välj närmaste Ci (i = 1, 2, 3..k)

Lägg till Xi till Ci

3. Beräkna centroid med hjälp av rätt mätvärden (dvs. intraclusteravstånd)

4, upprepa steg (2) (3) tills konvergerar

- K betyder ++

Initialiseringssteget i K betyder är rent slumpmässigt och baserat på initialiseringen förändras klusteringen drastiskt. K betyder att ++ löser detta problem genom att initialisera k på ett sannolikt sätt i stället för ren randomisering. K betyder att ++ är mer stabilt än klassiska K-medel.

- K Medoids:

K-medoider är också en klusteralgoritm baserad på K-medel. Den huvudsakliga skillnaden mellan de två är centroiderna av K betyder inte nödvändigtvis i datauppsättningen vilket inte är fallet för K-medoider. K-medoider erbjuder bättre tolkbarhet för kluster. K betyder minimerar det totala kvadratfelet medan K-medoider minimerar skillnaden mellan punkter.

Slutsats

I den här artikeln diskuterade vi de mest populära algoritmerna för maskininlärning som används inom datavetenskap. Efter alla dessa kan en fråga komma att tänka på att " Vilken algoritm är bäst? " Det är klart att det inte finns någon vinnare här. Det beror bara på den aktuella uppgiften och företagens krav. Som bästa praxis börjar alltid med den enklaste algoritmen och ökar komplexiteten gradvis.

Rekommenderade artiklar

Detta har varit en guide till datavetenskapliga algoritmer. Här har vi diskuterat en översikt över datavetenskapliga algoritmer och två typer av datavetenskapliga algoritmer. Du kan också gå igenom våra givna artiklar för att lära dig mer-

- Data Science Platform

- Datavetenskapsspråk

- Klassificeringsalgoritmer

- Data Mining Algoritms

- Mest använda tekniker för lärande av ensemble

- Enkla sätt att skapa beslutsträd

- Komplett guide för datavetenskapens livscykel