Deep Learning intervjufrågor och svar

Idag ses Deep Learning som en av de snabbast växande teknikerna med en enorm förmåga att utveckla en applikation som har sett på sig som tuff för en tid tillbaka. Taligenkänning, bildigenkänning, hitta mönster i en dataset, objektklassificering i fotografier, karaktärstextgenerering, självkörande bilar och många fler är bara några exempel där Deep Learning har visat sin betydelse.

Så du har äntligen hittat ditt drömjobb i Deep Learning men undrar hur du knäcker Deep Learning-intervjun och vad som kan vara de troliga frågorna om Deep Learning-intervjuer. Varje intervju är annorlunda och omfattningen av ett jobb är också annorlunda. Med detta i åtanke har vi utformat de vanligaste intervjufrågorna och svaret för Deep Learning för att hjälpa dig att få framgång i din intervju.

Nedan finns några Deep Learning-intervjuer som ofta ställs i intervju och som också skulle kunna hjälpa till att testa dina nivåer:

Del 1 –Fråga om intervjuer för djup inlärning (grundläggande)

Den här första delen täcker grundläggande frågor och svar på Deep Learning-intervjuer

1. Vad är djup inlärning?

Svar:

Området för maskininlärning som fokuserar på djupa konstgjorda neurala nätverk som löst inspireras av hjärnor. Alexey Grigorevich Ivakhnenko publicerade den första generalen om att arbeta Deep Learning-nätverket. Idag har den sin tillämpning inom olika områden som datorsyn, taligenkänning, naturligt språkbearbetning.

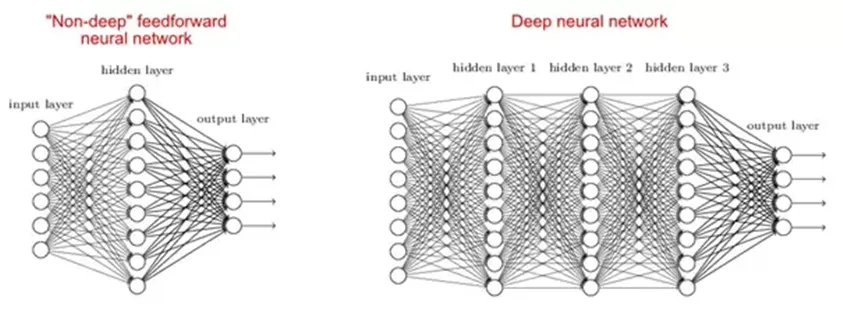

2. Varför är djupa nätverk bättre än grunt?

Svar:

Det finns studier som säger att både grunda och djupa nätverk kan passa i alla funktioner, men eftersom djupa nätverk har flera dolda lager ofta av olika typer så kan de bygga eller extrahera bättre funktioner än grunt modeller med färre parametrar.

3. Vad är kostnadsfunktionen?

Svar:

En kostnadsfunktion är ett mått på det neurala nätverkets noggrannhet med avseende på det givna träningsprovet och förväntad produktion. Det är ett enda värde, icke-vektor, eftersom det ger prestandan för det neurala nätverket som helhet. Det kan beräknas enligt funktionen Medelkvadratfel:

MSE = 1nΣi = 0n (Y i-Yi) 2

Där Y och önskat värde Y är vad vi vill minimera.

Låt oss gå till nästa Deep Learning-intervjufrågor.

4. Vad är gradientstigning?

Svar:

Gradient nedstigning är i princip en optimeringsalgoritm, som används för att lära sig värdet på parametrar som minimerar kostnadsfunktionen. Det är en iterativ algoritm som rör sig i riktning mot brantaste nedstigningen, definierad av lutningens negativa. Vi beräknar gradientnedstigningen för kostnadsfunktionen för en given parameter och uppdaterar parametern med formeln nedan: -

Θ: = Θ-αd∂ΘJ (Θ)

Där Θ - är parametervektorn, är α - inlärningshastighet, J (Θ) - en kostnadsfunktion.

5. Vad är bakpropagering?

Svar:

Backpropagation är en träningsalgoritm som används för ett flerlags neuralt nätverk. I den här metoden flyttar vi felet från ett slut på nätverket till alla vikter i nätverket och därmed möjliggör effektiv beräkning av lutningen. Det kan delas upp i flera steg enligt följande: -

Framåt spridning av träningsdata för att generera output.

Sedan kan man använda målvärde och utgångsvärdefel derivat kan beräknas med avseende på utgångsaktivering.

Sedan backpagneras vi för att beräkna derivat av felet med avseende på utaktivering på tidigare och fortsätter detta för alla dolda lager.

Med tidigare beräknade derivat för output och alla dolda lager beräknar vi felderivat med avseende på vikter.

Then Och sedan uppdaterar vi vikterna.

6. Förklara följande tre varianter av gradientstigning: batch, stokastisk och mini-batch?

Svar:

Stokastisk lutningsnedgång : Här använder vi bara ett enda träningsexempel för beräkning av lutnings- och uppdateringsparametrar.

Batch Gradient Descent : Här beräknar vi lutningen för hela datasatsen och utför uppdateringen vid varje iteration.

Mini-batch Gradient Descent : Det är en av de mest populära optimeringsalgoritmerna. Det är en variant av Stochastic Gradient Descent och här istället för ett enda träningsexempel används mini-batch av prover.

Del 2 - Frågor om djup inlärning (avancerat)

Låt oss nu titta på de avancerade frågorna om Deep Learning Interview.

7. Vilka är fördelarna med att minska batchgradienten?

Svar:

Nedan följer fördelarna med minisats-gradientnedstigning

• Detta är mer effektivt jämfört med stokastisk lutningens nedstigning.

• Generaliseringen genom att hitta platta minima.

• Mini-batchar tillåter hjälp att ungefärliga gradienten för hela träningsuppsättningen vilket hjälper oss att undvika lokala minima.

8. Vad är dataanormalisering och varför behöver vi det?

Svar:

Datanormalisering används under backpropagation. Huvudmotivet bakom datanormalisering är att minska eller eliminera dataredundans. Här räknar vi om värden för att passa in i ett specifikt intervall för att uppnå bättre konvergens.

Låt oss gå till nästa Deep Learning-intervjufrågor.

9. Vad är viktinitialisering i neurala nätverk?

Svar:

Viktinitialisering är ett av de mycket viktiga stegen. En dålig viktinitialisering kan förhindra ett nätverk från att lära sig men god viktinitialisering hjälper till att ge en snabbare konvergens och ett bättre totalfel. Fördjupningar kan generellt initialiseras till noll. Regeln för inställning av vikterna är att vara nära noll utan att vara för liten.

10. Vad är en automatisk kodare?

Svar:

En autoencoder är en autonom maskininlärningsalgoritm som använder backpropagation-principen, där målvärdena är inställda på att vara lika med de ingivna ingångarna. Internt har det ett doldt lager som beskriver en kod som används för att representera ingången.

Några viktiga fakta om autokodaren är följande:

• Det är en ML-algoritm som inte övervakas liknar Principal Component Analysis

• Det minimerar samma objektiva funktion som principkomponentanalys

• Det är ett neuralt nätverk

• Neuralnätets målutgång är dess inmatning

11. Är det OK att ansluta från en Layer 4-utgång tillbaka till en Layer 2-ingång?

Svar:

Ja, detta kan göras med tanke på att utdata från lager 4 är från föregående tidssteg som i RNN. Vi måste också anta att den föregående inmatningsgruppen ibland korreleras med den aktuella bunten.

Låt oss gå till nästa Deep Learning-intervjufrågor.

12. Vad är Boltzmann-maskinen?

Svar:

Boltzmann Machine används för att optimera lösningen av ett problem. Boltzmann-maskinens arbete är i princip att optimera vikterna och kvantiteten för det givna problemet.

Några viktiga punkter om Boltzmann Machine -

• Den använder en återkommande struktur.

• Den består av stokastiska neuroner, som består av en av de två möjliga tillstånden, antingen 1 eller 0.

• Neuronerna i detta är antingen i ett adaptivt (fritt tillstånd) eller fastklämt (fryst tillstånd).

• Om vi använder simulerad glödgning på diskret Hopfield-nätverk, skulle det bli Boltzmann Machine.

13. Vilken roll har aktiveringsfunktionen?

Svar:

Aktiveringsfunktionen används för att introducera icke-linearitet i nervnätverket och hjälper den att lära sig mer komplexa funktioner. Utan vilken skulle det neurala nätverket bara kunna lära sig linjär funktion som är en linjär kombination av dess inmatningsdata.

Rekommenderade artiklar

Detta har varit en guide till lista över intervjufrågor och svar på Deep Learning-intervjuer så att kandidaten lätt kan slå ned dessa Deep Learning-intervjufrågor. Du kan också titta på följande artiklar för att lära dig mer

- Lär dig de 10 mest användbara intervjufrågorna från HBase

- Användbara maskininlärningsintervjufrågor och svar

- Topp 5 mest värdefulla intervjufrågor för datavetenskap

- Viktiga Ruby intervjufrågor och svar