Vad är Bayes sats?

Bayes teorem är ett recept som visar hur man kan uppdatera sannolikheterna för teorier när de får bevis. Det strävar efter i princip från maximeringarna av villkorad sannolikhet, men det kan användas för att kunna resonera om ett brett utbud av frågor inklusive övertygelse av övertygelse.

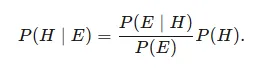

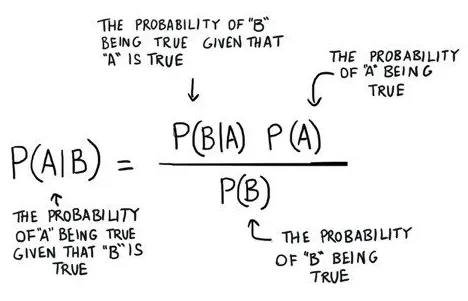

Med en teori H och bevis E uttrycker Bayes teorem att kopplingen mellan spekulationens sannolikhet innan beviset P (H) och sannolikheten för teorin i samband med att få beviset P (H∣E) är

Det är ett vackert begrepp med sannolikhet där vi finner sannolikheten när vi vet annan sannolikhet

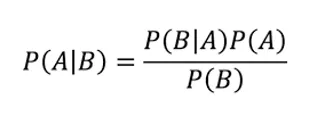

Som säger: hur regelbundet A händer med tanke på att B inträffar, sammansatt P (A | B),

När vi vet: hur regelbundet B händer med tanke på att An inträffar, sammansatt P (B | A)

dessutom, hur troligt är An utan någon annan, sammansatt P (A)

vad mer är, hur troligt är B utan någon annan, sammansatt P (B)

Exempel på Bayes sats

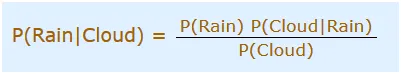

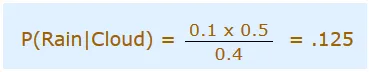

Du arrangerar en utflykt idag, emellertid morgonen är mulen, Gud hjälper oss! hälften av varje stormig dag börjar skuggigt! I alla fall är skuggiga morgnar normala (cirka 40% av dagarna börjar molnigt) Dessutom är det vanligtvis en torr månad (bara 3 av 30 dagar kommer i allmänhet vara stormigt eller 10%). Vad är sannolikheten för regn under dagen? Vi kommer att använda regn för att betyda regn under dagen och moln för att betyda mulen morgon. Möjligheten för Rain given Cloud består av P (Rain | Cloud)

Så vi bör placera det i ekvationen:

- P (regn) Sannolikhet för att det blir regn = 10% (ges)

- P (Moln | regn) Troligt att moln finns där och regn händer = 50%

- P (Cloud) är sannolikheten för att moln är där = 40%

Så vi kan säga att I c:

Det är Bayes sats: att du kan använda sannolikheten för en sak för att förutse sannolikheten för något annat. Ändå är Bayes sats allt annat än en statisk sak. Det är en maskin som du skiftnycklar för att förbättra och bättre prognoser som nya bevisytor. En spännande aktivitet är att leda till faktorerna genom att återplacera distinkta teoretiska egenskaper till P (B) eller P (A) och överväga deras sammanhängande effekt på P (A | B). Till exempel, om du ökar nämnaren P (B) till höger, då faller P (A | B) ned. Fast modell: En rinnande näsa är en indikation på mässlingen, men ändå är rinnande näsor onekligen mer typiska än hudutslag med små vita fläckar. Det vill säga, om du väljer P (B) där B är en rinnande näsa, vid det tillfället avvisar återfall av rinnande näsor i allmänheten möjligheten att rinnande näsa är en indikation på mässling. Sannolikheten för att ett mässling hittas minskar med avseende på biverkningar som blir gradvis normala; dessa manifestationer är inte solida pekare. På samma sätt, när mässlingar blir allt vanligare och P (A) går upp i telleren till höger, går P (A | B) väsentligen upp på grund av att mässlingarna helt enkelt ofta är mer sannolikt att ta lite hänsyn till biverkningen som du funderar på.

Användning av Bayes sats i maskininlärning

Naive Bayes Classifier

Naive Bayes är en karaktäriseringsberäkning för dubbla (tvåklassiga) och grupperingar i flera klasser. Systemet är minst krävande att förstå när det visas med dubbel- eller rakt ut informationskvaliteter.

Det kallas naiva Bayes eller obesläktade Bayes mot bakgrund av det faktum att beräkningen av sannolikheterna för varje teori strömlinjeformas för att göra deras räkning rörlig. I motsats till att försöka fastställa uppskattningarna för varje dragkänsla P (d1, d2, d3 | h), anses de vara begränsande fria med tanke på det objektiva värdet och bestämmas som P (d1 | h) * P (d2 | H, etc.

Detta är ett fast antagande som är mest långtgående i äkta information, till exempel att egenskaperna inte kommunicerar. Förresten fungerar metodiken chockerande bra när det gäller information där denna presumtion inte rymmer.

Porträtt som används av Naive Bayes-modeller

Skildringen av en naiv Bayes-algoritm är sannolikheten.

Uppsättningar med sannolikheter läggs fram för att begära en vetenskaplig naiv Bayesisk modell. Detta innehåller:

Klassens sannolikhet: Sannolikheten för allt i förberedelsedatabasen.

Villkorad sannolikhet: Den villkorade sannolikheten för varje instansinfo värt varje klasskänsla.

Ta in en Naive Bayes-modell från data. Att ta in en naiv Bayesisk modell från förberedelserinformation är snabbt. Förberedelserna är snabba mot bakgrund av det faktum att ensamma sannolikhetsvärden för varje instans av klassen och sannolikhetsvärdet för varje instans av klassen med särskiljningsinformation (x) -värden bör bestämmas. Inga koefficienter ska vara anpassade av förbättringssystem.

Beräkna klassens sannolikheter

En klass sannolikhet är i grund och botten återfallet av fall som har en plats med varje klass isolerad av det totala antalet fall.

Till exempel i en parallell klass bestäms sannolikheten för att ett fall har en plats med klass 1 som:

Sannolikhet (klass = 1) = total (klass = 1) / (total (klass = 0) + total (klass = 1))

I det mest enkla fallet har varje klass en sannolikhet på 0, 5 eller hälften för en tvåfaldig klassificeringsproblem med ett liknande antal händelser i varje instans av klassen.

Beräkna villkorad sannolikhet

De villkorade sannolikheterna är återfallet av varje dragkänsla för en given klass värd att delas upp genom återkommande exempel med den klasskänslan.

Alla tillämpningar av Bayes teorem

Det finns många användningar av Bayes teorem i verkligheten. Försök att inte stressa med chansen att du inte ser alla aritmetikerna omedelbart. Att helt enkelt få en känsla av hur den fungerar är tillräcklig för att börja.

Bayesiska beslutsteori är ett mätbart sätt att hantera frågan om exempelklassificering. Enligt denna hypotese förväntas det att den grundläggande sannolikhetsöverföringen för klasserna är känd. På detta sätt förvärvar vi en perfekt Bayes Classifier mot vilken varje annan klassificerare fattas ett beslut för genomförande.

Vi kommer att prata om de tre grundläggande användningarna av Bayes sats:

- Naive Bayes klassificerare

- Diskriminerande funktioner och beslutsytor

- Bayesian Parameter Estimation

Slutsats

Storslagenhet och intensitet av Bayes teorem slutar aldrig att förbluffa mig. En grundidé, som ges av en präst som gick vidare för över 250 år tillbaka, har dess användning i de absolut mest omisskännliga AI-förfarandena idag.

Rekommenderade artiklar

Detta är en guide till Bayes sats. Här diskuterar vi användningen av Bayes teorem i maskininlärning och den beskrivning som används av naiva Bayes modeller med exempel. Du kan också titta på följande artiklar för att lära dig mer -

- Naive Bayes algoritm

- Typer av maskininlärningsalgoritmer

- Maskininlärningsmodeller

- Maskininlärningsmetoder