Introduktion till bakåt eliminering

Eftersom man och maskin knackar mot digital evolution, redovisar olika teknikmaskiner att inte bara utbilda sig utan också smart utbildas för att komma ut med bättre erkännande av verkliga föremål. En sådan teknik introducerades tidigare kallat ”bakåt eliminering” som avsåg att gynna oundgängliga funktioner samtidigt som man utrotar nugatoriska funktioner för att skaffa sig bättre optimering i en maskin. Maskins hela kunskap om objektigenkänning står i proportion till vilka funktioner den överväger.

Funktioner som inte har någon referens till den förutsagda utgången måste urladdas från maskinen och det avslutas genom bakåt eliminering. God precision och tidskomplexitet för att känna igen maskinens verkliga ordobjekt beror på dess inlärning. Så bakåt eliminera spelar sin styva roll för val av funktioner. Den beräknar hastigheten för beroende av funktioner till den beroende variabeln finner betydelsen av dess tillhörighet i modellen. För att ackreditera detta kontrollerar den den beräknade räntan med en standardbetygetivå (säga 0, 06) och tar ett beslut för val av funktion.

Varför avskräcker vi bakåt eliminering ?

Oavsiktliga och redundanta drag driver fram maskinens logik. Det äter onödigt tid och modellresurser. Så den ovan nämnda tekniken spelar en kompetent roll för att smida modellen till enkel. Algoritmen odlar den bästa versionen av modellen genom att optimera dess prestanda och avkorta dess användbara resurser.

Det minskar de minst anmärkningsvärda funktionerna från modellen som orsakar buller vid avgörandet av regressionslinjen. Irrelevanta objektdrag kan orsaka missklassificering och förutsägelse. Irrelevanta egenskaper hos ett företag kan utgöra en obalans i modellen med avseende på andra väsentliga egenskaper hos andra objekt. Bakåt eliminering främjar montering av modellen i bästa fall. Därför rekommenderas eliminering av bakåt att använda i en modell.

Hur applicerar man bakåt eliminering?

Bakåt eliminering börjar med alla funktionsvariabler och testar den med den beroende variabeln under en vald montering av modellkriteriet. Det börjar utrota de variabler som försämrar den passande regressionslinjen. Upprepa denna radering tills modellen har passat bra. Nedan följer stegen för att öva bakåt eliminering:

Steg 1: Välj lämplig nivå för betydelse att ligga i maskinens modell. (Ta S = 0, 06)

Steg 2: Fed alla tillgängliga oberoende variabler till modellen med avseende på den beroende variabeln och dator lutningen och fånga upp för att rita en regressionslinje eller passningslinje.

Steg 3: Korsa med alla oberoende variabler som har det högsta värdet (Ta I) en efter en och fortsätt med följande toast: -

a) Om I> S, kör det fjärde steget.

b) Annars avbryta och modellen är perfekt.

Steg 4: Ta bort den valda variabeln och öka traversalen.

Steg 5: Smej igen modellen igen och beräkna lutningen och skärningen av monteringslinjen igen med restvariabler.

De ovannämnda stegen sammanfattas i avvisningen av de funktioner vars signifikansgrad är över det valda signifikansvärdet (0, 06) för att undvika överklassificering och överutnyttjande av resurser som observerats som hög komplexitet.

Förtjänster och begränsningar av bakåt eliminering

Här är några meriter och nedskärningar av bakåt eliminering som ges nedan i detalj:

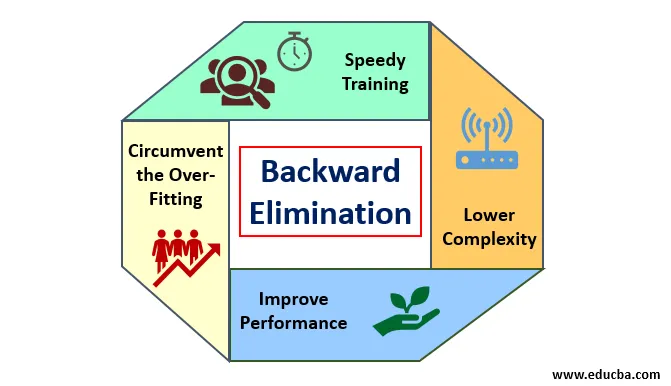

1. Förtjänster

Fördelar med att eliminera bakåt är följande:

- Snabbträning: Maskinen tränas med en uppsättning tillgängliga mönsterfunktioner som görs på mycket kort tid om osynliga funktioner tas bort från modellen. Snabb utbildning av datauppsättning kommer bara in i bilden när modellen har att göra med betydande funktioner och utesluter alla brusvariabler. Det drar en enkel komplexitet för träning. Men modellen bör inte genomgå undermontering som uppstår på grund av brist på funktioner eller otillräckliga prover. Provfunktionen bör vara riklig i en modell för bästa klassificering. Tiden som krävs för att träna modellen bör vara mindre medan klassificeringsnoggrannheten bibehålls och utan någon förutsägbar variabel.

- Lägre komplexitet: Komplexiteten hos modellen råkar vara hög om modellen överväger omfattningen av funktioner inklusive brus och ej relaterade funktioner. Modellen kräver mycket utrymme och tid för att bearbeta en sådan mängd funktioner. Detta kan öka graden av noggrannhet för mönsterigenkänning, men frekvensen kan också innehålla brus. För att bli av med en så hög komplexitet hos modellen spelar den bakåt eliminerade algoritmen en nödvändig roll genom att dra tillbaka de oönskade funktionerna från modellen. Det förenklar processens logik för modellen. Endast några väsentliga funktioner är tillräckligt för att få en bra passform som innehåller en rimlig noggrannhet.

- Förbättra prestanda: Modellens prestanda beror på många aspekter. Modellen genomgår optimering genom att använda bakåt eliminering. Optimeringen av modellen är optimeringen av datasatsen som används för att utbilda modellen. Modellens prestanda är direkt proportionell mot dess optimeringshastighet som beror på frekvensen av betydande data. Den bakåt eliminerande processen är inte avsedd att starta förändring från någon lågfrekvens predikator. Men det börjar bara förändringar från högfrekvensdata eftersom mestadels modellens komplexitet beror på den delen.

- Omgå överspänningen: Den överpassande situationen inträffar när modellen fick för många datasätt och klassificering eller förutsägelse utförs där vissa predikatorer fick ljud från andra klasser. I denna montering skulle modellen ge oväntat hög noggrannhet. Vid övermontering kan modellen misslyckas med att klassificera variabeln på grund av förvirring skapad i logik på grund av för många förhållanden. Den bakåt elimineringstekniken begränsar den främmande funktionen för att kringgå situationen för övermontering.

2. Förluster

Begränsningar av bakåt eliminering är som följer:

- I den bakåt eliminerade metoden kan man inte ta reda på vilken predikator som är ansvarig för att avvisa en annan predikator på grund av att den når till obetydlighet. Till exempel, om predikator X har någon betydelse som var tillräckligt bra för att bo i en modell efter att ha lagt till Y-predikatorn. Men betydelsen av X blir föråldrad när en annan predikator Z kommer in i modellen. Så den bakåt elimineringsalgoritmen uppenbarar inte något beroende mellan två prediktorer som händer i "Framåtvalstekniken".

- Efter att någon funktion har kasserats från en modell med en bakåt eliminationsalgoritm, kan den funktionen inte väljas igen. Kort sagt, bakåt eliminering har inte ett flexibelt tillvägagångssätt för att lägga till eller ta bort funktioner / prediktorer.

- Normerna för att välja signifikansvärdet (0, 06) i modellen är oflexibla. Bakåt eliminering har inte en flexibel procedur för att inte bara välja utan också ändra det obetydliga värdet som krävs för att hämta den bästa passformen under ett adekvat datasystem.

Slutsats

Bakåt elimineringstekniken insåg att förbättra modellens prestanda och för att optimera dess komplexitet. Det används levande i flera regressioner där modellen behandlar det omfattande datasättet. Det är ett enkelt och enkelt tillvägagångssätt jämfört med val av framåt och korsvalidering där överbelastning av optimering uppstod. Den bakåt elimineringstekniken initierar eliminering av funktioner med högre betydelsevärde. Dess grundläggande mål är att göra modellen mindre komplex och förbjuda alltför passande situation.

Rekommenderade artiklar

Detta är en guide till bakåt eliminering. Här diskuterar vi hur man tillämpar bakåt eliminering tillsammans med meriter och underskott. Du kan också titta på följande artiklar för att lära dig mer-

- Hyperparameter-maskininlärning

- Clustering in Machine Learning

- Java Virtual Machine

- Oövervakad maskininlärning